Par Catherine Belzung

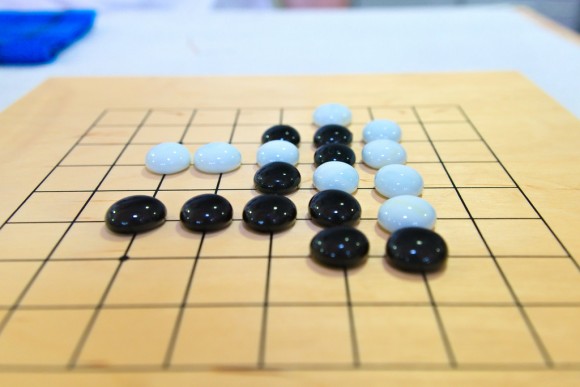

Pour la troisième fois consécutive, en mars 2016, le système d’Intelligence Artificielle AlphaGo (développé par la société DeepMind, filiale de Google) a battu le champion Sudcoréen Lee Sedol dans un match de go. Au final sur 5 matches, la machine en a gagné 4. Pourtant, le champion humain, qui domine le monde du jeu de go depuis une décennie, a utilisé des coups singuliers, peu orthodoxes, dans le but de mettre à l’épreuve la créativité du système informatique.

Le jeu de go est réputé particulièrement difficile car le nombre de combinaisons à explorer à chaque coup est particulièrement élevé (10170, soit plus que le nombre d’atomes dans l’univers) ce qui rend difficile de gagner en essayant de comparer les issues de tous les coups possibles. On considère en général que pour gagner, il ne suffit pas de savoir calculer, mais qu’il faut être créatif, innovant, intuitif… qualités que l’on n’attribue en général pas à un système artificiel. Plus surprenant encore : alors que Deep Blue (le premier système de jeu d’échec qui a battu le grand maître Garry Kasparov en 1997) avait été programmé pour gagner aux échecs, ce n’est pas le cas de AlphaGo. Ce système a tout simplement appris à jouer au jeu de go, à l’aide de deux stratégies : une recherche arborescente (on observe toutes les séquences possibles à partir d’une configuration donnée) et d’une approche appelée « deep learning » (réseaux de neurones profonds), méthode qui imite le fonctionnement du cerveau humain et au cours de laquelle le système artificiel apprend lui même à partir d’un très grand nombre d’exemples. Mais peut-on en conclure que désormais les systèmes artificiels dépassent les systèmes naturels, ou que la machine est plus intelligente que l’Homme ?

Il ne faut sans doute pas aller si vite.. Tout d’abord, il faut observer que AlphaGo ne sait « que » jouer au jeu de go, c’est à dire qu’il est remarquablement performant dans une situation où les règles sont claires, précises, définies à l’avance. Ce n’est pas du tout ce qui se passe dans le monde habituel, où les êtres humains évoluent dans un monde changeant sans cesse, et dans lequel les règles sont floues. D’ailleurs, lorsque l’on fait passer des tests d’intelligence à des systèmes artificiels, ils ne dépassent pas pour l’instant le niveau d’un enfant de 4 ans. Il est d’ailleurs remarquable que les programmes artificiels de conversation comme chatbot, qui permettent une conversation entre un humain et un robot, on trouve, au milieu d’un échange qui semble sensé, des passages comme celui ci : « Humain : quel est ton travail ? Réponse de la machine : je suis avocat. Humain : que fais tu dans la vie ? Réponse de la machine : je suis docteur ». Ces programmes échouent donc encore au fameux test de Turing (dans lequel le défi pour la machine est de se faire passer pour un humain dans une conversation de quelques minutes). Une autre raison de cet échec est que la machine n’a pas de conscience de soi (elle ne sait pas qu’elle a gagné, ne sait pas non qu’il y a des enjeux dans ce match) et pas d’émotion (elle n’est pas « contente » d’avoir gagné). C’est sans doute pour cela que le champion a déclaré à la fin : « C’est moi, Lee Sedol, qui ai perdu, mais pas l’humanité ».

Alain Peyrefitte avait intitulé son livre sur La Chine : « Quand la Chine s’éveillera ». C’était une citation de Napoléon. La deuxième partie de la phrase était, on s’en souvient : « Le monde tremblera « . Napoléon avait raison !

Beaucoup parlent aujourd’hui de l' »éveil » des machines suffisamment puissantes pour faire naitre en elles la conscience. Il me semble qu’il y a dans cette affirmation une part de phantasme créateur. Mais d’un autre côté les progrès fulgurants de l’IA semblent bien aller dans une direction de ce type. Ce qui ferait de ses promoteurs des apprentis sorciers car l’éveil de la conscience (qui suppose en réalité une communauté plus qu’une intelligence) ne s’accompagne pas, dans le cas de l’IA, d’un éveil de la conscience morale.

Où en est le débat sur cette question chez les scientifiques ?

Nul doute, je préfère jouer avec vous !

Oui, moi aussi je préfère jouer avec de « vraies personnes ». Concernant la conscience (dans le sens de conscience de soi), c’est un débat actuellement assez vif en philosophie de l’esprit. Car soit l’on considère que la conscience résulte du fonctionnement d’un système physique comme le cerveau (ce que font les physicalistes) et dans ce cas on peut envisager de la simuler dans un système artificiel, soit on considère avec des philosophes comme Chalmers que beaucoup de choses peuvent résulter du fonctionnement cérébral, sauf la conscience.. dans ce cas, il sera difficile de la créer dans un système artificiel.. Je serais plutôt de cet avis! en plus, même si on pouvait simuler la conscience, cela ne prouve pas qu’il y a une conscience!